Quand un marchand vend sur PrestaShop, Magento et trois marketplaces en parallèle, la gestion manuelle des fiches produit devient un cauchemar opérationnel. C'est exactement le problème que résout un PIM : centraliser les données produit et les diffuser automatiquement vers chaque canal.

Pendant quatre ans en tant que CTO d'une plateforme PIM/DAM SaaS, j'ai conçu et maintenu les connecteurs PrestaShop et Magento qui alimentaient les catalogues de nos clients. Cet article documente les choix techniques, les pièges rencontrés et les patterns qui ont survécu à la production.

L'architecture d'un connecteur PIM

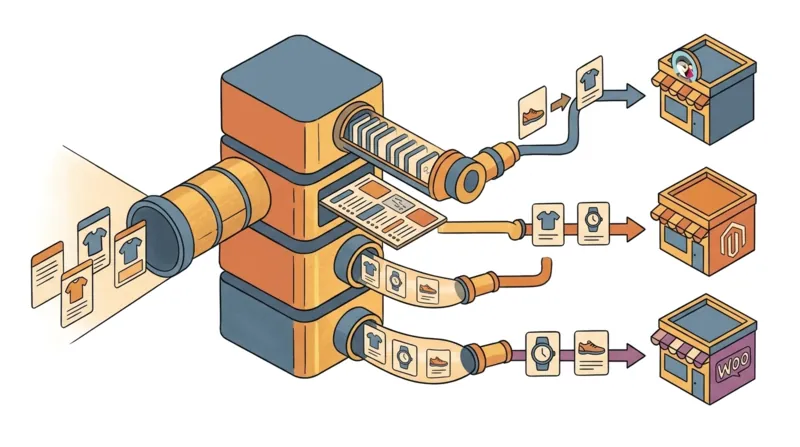

Un connecteur PIM n'est pas un simple script d'export. C'est un pipeline de transformation de données qui doit gérer la complexité de deux modèles incompatibles : celui du PIM (flexible, multi-langue, multi-scope) et celui de la plateforme cible (rigide, avec ses propres conventions et contraintes).

L'architecture que nous avons mise en place repose sur quatre couches distinctes, exécutées séquentiellement via des générateurs PHP pour maîtriser la consommation mémoire :

- Source — Extraction des données produit depuis le PIM, filtrable par catalogue, catégorie ou attribut.

- Mapping — Transformation des attributs PIM vers les champs de la plateforme cible. C'est la couche la plus complexe.

- Format — Sérialisation dans le format attendu (CSV, XML, JSON selon la plateforme).

- Adapter — Envoi vers la destination (API REST, FTP, endpoint spécifique).

Chaque couche est un générateur PHP qui yield ses résultats

à la suivante. Sur un catalogue de 50 000 produits

avec 80 attributs par fiche, ce design évite

de charger l'intégralité du catalogue en mémoire.

Le pipeline consomme et transforme les données

produit par produit.

Le mapping : le cœur du problème

Le mapping est la partie qui concentre 80 % de la complexité d'un connecteur. Le PIM stocke les données dans un modèle EAV (Entity-Attribute-Value) flexible : chaque attribut peut être localisable (une valeur par langue), scopable (une valeur par canal) et typé (texte, prix, média, sélection multiple…).

PrestaShop et Magento, eux, attendent des champs fixes avec des formats précis. Le mapping doit résoudre plusieurs problèmes simultanément.

Champs scalaires et localisés

Les champs simples (référence, EAN, poids) sont un mapping

direct : un attribut PIM vers un champ PrestaShop.

Les champs localisés (nom, description) doivent être dupliqués

pour chaque langue active sur la boutique. Le PIM stocke

name[fr_FR] et name[en_US]

séparément ; le connecteur doit les regrouper dans la structure

attendue par l'API de la plateforme.

Déclinaisons et variantes

C'est le point le plus délicat. PrestaShop utilise des « déclinaisons » (combinaisons d'attributs comme taille + couleur), Magento parle de « configurable products » avec des « simple products » enfants. Le PIM, lui, peut modéliser les variantes de différentes manières : produits liés, attributs de type collection, ou produits enfants avec héritage d'attributs.

Le connecteur doit transformer un modèle flexible en un modèle rigide, et cette transformation dépend de la façon dont le client a structuré son catalogue dans le PIM. Il n'existe pas de mapping universel des variantes — chaque intégration nécessite une configuration spécifique.

Catégories et associations

L'arborescence des catégories PIM ne correspond jamais exactement à celle de la boutique. Le mapping de catégories est un tableau de correspondance maintenu manuellement par le client, exposé dans l'interface du PIM. Le connecteur injecte les identifiants de catégories cibles dans chaque fiche exportée.

PrestaShop : API REST et WebService

PrestaShop expose un WebService XML historique et, depuis la version 8, une API REST plus moderne. En pratique, beaucoup de marchands tournent encore sur des versions antérieures, donc le connecteur doit supporter les deux interfaces.

Le WebService XML de PrestaShop est fonctionnel mais verbeux. La création d'un produit avec ses déclinaisons, images et associations nécessite plusieurs appels séquentiels : d'abord le produit, puis les déclinaisons une par une, puis les images. Il n'existe pas d'endpoint « batch » pour insérer plusieurs produits en une seule requête.

Pour un catalogue de 10 000 produits avec 3 déclinaisons en moyenne, ça représente environ 40 000 appels API. Sans optimisation, une synchronisation complète peut prendre plusieurs heures. La stratégie : ne synchroniser que les produits modifiés depuis le dernier export, en s'appuyant sur les dates de mise à jour du PIM.

Magento : API REST et GraphQL

Magento offre une API REST complète et, depuis la version 2.4, une API GraphQL côté storefront. Pour l'intégration PIM, c'est l'API REST admin qui est utilisée.

L'avantage de Magento : les endpoints « bulk » permettent d'envoyer plusieurs produits en une seule requête. L'API accepte des lots de produits et les traite de manière asynchrone. Le connecteur envoie un lot, récupère un identifiant de tâche, et vérifie le statut de traitement ensuite.

Le piège principal avec Magento est la gestion des « attribute sets ». Chaque produit appartient à un attribute set qui détermine ses attributs disponibles. Si le mapping envoie un attribut qui n'existe pas dans l'attribute set du produit, Magento rejette silencieusement la valeur sans erreur explicite. Ce comportement a causé des heures de débogage avant qu'on l'identifie et qu'on ajoute une validation côté PIM.

Les accesseurs : abstraction de l'accès aux données

Un pattern qui s'est révélé indispensable est celui des « accesseurs ». Le mapping ne lit pas directement les propriétés d'un produit ; il passe par une couche d'abstraction qui supporte plusieurs stratégies d'accès :

-

Accès par propriété — lecture directe

d'un champ (

product.sku,product.weight). -

Accès par formule — expression calculée

à partir de plusieurs attributs. Par exemple,

sku + "-" + color_codepour générer une référence de déclinaison. - Valeur fixe — une constante injectée dans tous les produits (par exemple, un code fournisseur ou un identifiant de marque).

Ce système permet aux clients de configurer des mappings complexes sans modification de code. Un marchand qui génère ses références PrestaShop par concaténation de SKU et taille peut le faire via l'interface, sans développement spécifique.

Gestion des erreurs et idempotence

Un export de 50 000 produits va échouer. Pas « peut-être » : il va échouer. Timeout réseau, produit avec des données invalides, limite de taux de l'API dépassée. La question n'est pas d'empêcher les erreurs mais de les gérer proprement.

Chaque produit traité produit un résultat typé : succès, échec (avec la raison) ou ignoré. Les erreurs sont collectées sans interrompre le pipeline — un produit invalide ne doit pas bloquer les 49 999 autres.

L'idempotence est assurée par le pattern

INSERT … ON DUPLICATE KEY UPDATE

côté PIM : ré-exécuter un import ne crée pas de doublons.

Côté plateformes, l'export identifie chaque produit

par sa référence unique et utilise un PUT

(création ou mise à jour) plutôt qu'un POST

(création seule).

Orchestration et planification

Les exports ne sont pas lancés manuellement. Un orchestrateur vérifie périodiquement quels workflows doivent être exécutés, en se basant sur des expressions cron configurées par canal. Un marchand peut synchroniser ses prix toutes les heures et son catalogue complet une fois par nuit.

Chaque export est dispatché comme un message asynchrone, traité par un worker dédié. Ce découplage permet de paralléliser les exports vers plusieurs canaux sans bloquer l'interface du PIM.

Ce que j'en retiens

Après quatre ans à construire et maintenir ces connecteurs, quelques convictions :

- Le mapping est un produit en soi. Il ne suffit pas de câbler deux API ensemble. La configuration du mapping doit être accessible aux équipes métier, pas uniquement aux développeurs.

-

Les générateurs PHP changent tout.

Sur des volumes de données e-commerce (dizaines de milliers

de produits), le streaming via

yieldest la seule approche viable en termes de mémoire. - Chaque plateforme est un cas particulier. PrestaShop, Magento et WooCommerce ont des API, des modèles de données et des comportements d'erreur radicalement différents. L'abstraction par couches (source → mapping → format → adapter) permet de mutualiser le pipeline sans masquer les spécificités.

- L'export différentiel est indispensable. Synchroniser uniquement les produits modifiés réduit les temps d'export de plusieurs heures à quelques minutes, et diminue la pression sur les API des plateformes cibles.